O que antes era um mero incômodo para o Twitter se tornou uma grande dor de cabeça para a rede de microblogs. Em outubro, o chefe do departamento jurídico do Twitter declarou a uma comissão de investigação do Senado americano que bots russos haviam publicado 1,4 milhões de tuítes nos dias que antecederam a eleição de Donald Trump à presidência dos EUA. Esses bots – perfis criados por programas de computador que fingem ser usuários de verdade – também entraram em ação depois de um tiroteio em uma escola na Flórida. Em janeiro, uma matéria do New York Times descreveu como empresas americanas, executivos, jornalistas e celebridades costumam contratar bots como seguidores para catapultar a própria popularidade.

Desde então, o Twitter vem sofrendo as consequências. Na revista Vanity Fair do mês passado, o escritor Nick Bilton, que acompanha de perto a rede social em seu trabalho como jornalista, acusou o Twitter de “fazer vista grossa para o problema [dos bots]”durante anos para inflar o número de usuários ativos. Além disso, ex-executivos descontentes com a empresa disseram a Maya Kosoff, também na Vanity Fair, que a rede social estava empregando pessoas demais e tecnologia de menos para resolver a questão dos bots e outros problemas de conduta. “Havia um exército de moderadores, mas sem o suporte de uma boa plataforma tecnológica”, disse um deles.

Embora o Twitter não tenha investido muito em softwares antibots, alguns usuários que entendem do assunto resolveram agir. Eles estão desenvolvendo e aprimorando programas que usam a interface de programação de aplicativos (API) do Twitter, do Google e de outros serviços online para rastrear contas falsas e usuários suspeitos. A iniciativa, pelo menos entre os pesquisadores com quem conversei, começou caçando bots que promoviam conteúdos pornográficos – um tipo de perfil falso fácil de ser identificado –, mas o plano é ampliar o projeto para abarcar outros tipos de bots. O trabalho de pesquisa e programação é totalmente voluntário, realizado nas horas vagas, mas já conseguiu identificar dezenas de milhares de contas falsas, um indício de que o Twitter ainda tem muito trabalho pela frente para se livrar do problema.

Autodidatas da detecção de autômatos

Um dos caçadores de bots nas horas vagas é Baptiste Robert, especialista em cibersegurança e desenvolvedor freelancer de aplicativos para Android, que percebeu, em fevereiro deste ano, que várias usuárias com fotos de perfil provocantes haviam começado a seguir sua conta no Twitter e curtir seus tuítes. Além das imagens eróticas, os bots tinham outras coisas em comum: as supostas mulheres tinham bios (descrições pessoais) parecidas, seguiam as mesmas pessoas, costumavam curtir tuítes em vez de compartilhá-los, tinham menos de mil seguidores e incluíam links em suas bios.

Uma das primeiras contas analisadas por Robert, atualmente suspensa, continha um link para o site “datewith-me1.com”, registrado com um endereço de e-mail russo também associado às páginas “instaflirtbook.com”, “hookupviplocators1.com”, “yoursexydream11.com” e “sex4choice.com”. Segundo Robert, vários sites de phishing (tipo de golpe virtual com o intuito de obter dados pessoais da vítima) pareciam estar usando o mesmo esquema – e provavelmente pertenciam à mesma pessoa.

“A ideia era mostrar como é fácil encontrar esses bots fazendo uma simples busca no Google.”

Então, Robert decidiu criar um bot para provar a seus seguidores como era fácil encontrar esses bots. Depois de identificar uma série de semelhanças entre os perfis falsos, ele usou buscas avançadas e o serviço de busca de imagens do Google para descobrir outros bots. Em seguida, escreveu algunas centenas de linhas de código em Python, uma linguagem de programação, para criar um bot capaz de caçar e desmascarar contas falsas. “Levei menos de uma hora para programar a primeira versão do @PornBotHunter”, conta Robert. “A ideia inicial era mostrar como é fácil encontrar esses bots fazendo uma simples busca no Google”, explica. O “caçador de bots” publica de hora em hora um tuíte sobre um novo bot pornô, com informações como handle (nome de usuário do Twitter), foto de perfil, número de seguidores, data de criação do perfil, links externos, e se a conta já foi suspensa pelo Twitter. O programa também publica relatórios de atividade mais detalhados no Pastebin, um site de hospedagem de textos muito popular entre especialistas em cibersegurança. Os usuários podem reclamar de falsos positivos no Twitter de Robert.

O pesquisador é o primeiro a admitir que seu software é apenas uma prova de conceito. Agora ele está reescrevendo o código para identificar outros tipos de bots, como bots políticos ou mineradores de criptomoedas. Ele também estuda a possibilidade de criar um sistema que ajude os usuários do Twitter a identificar bots entre seus seguidores. Quando o programa chegar a uma versão estável e revisada, Robert pretende divulgar o código-fonte na internet.

É impressionante que uma ferramenta criada em apenas uma hora esteja desmascarando bots antes do próprio Twitter. Até o dia 1º de março, o @PornBotHunter já havia listado 197 contas aparentemente falsas no Pastebin, e 66 delas – quase um terço – ainda não haviam sido suspensas. As outras foram suspensas ao serem indexadas pelo Google ou após serem denunciadas por Robert ao Twitter. Algumas das contas que permaneceram ativas não parecem ser falsas e podem ter sido apenas hackeadas temporariamente.

Enquanto isso, na Suécia, um grupo de cinco arquivistas, jornalistas de dados e pesquisadores havia notado que muitos usuários do Twitter recebiam uma enxurrada de links e imagens eróticas por parte de contas automatizadas. Eles decidiram analisar alguns desses bots em um projeto chamado Botjakten (“jakten” significa “caça” em sueco). O código-fonte do Botjakten está disponível no GitHub.

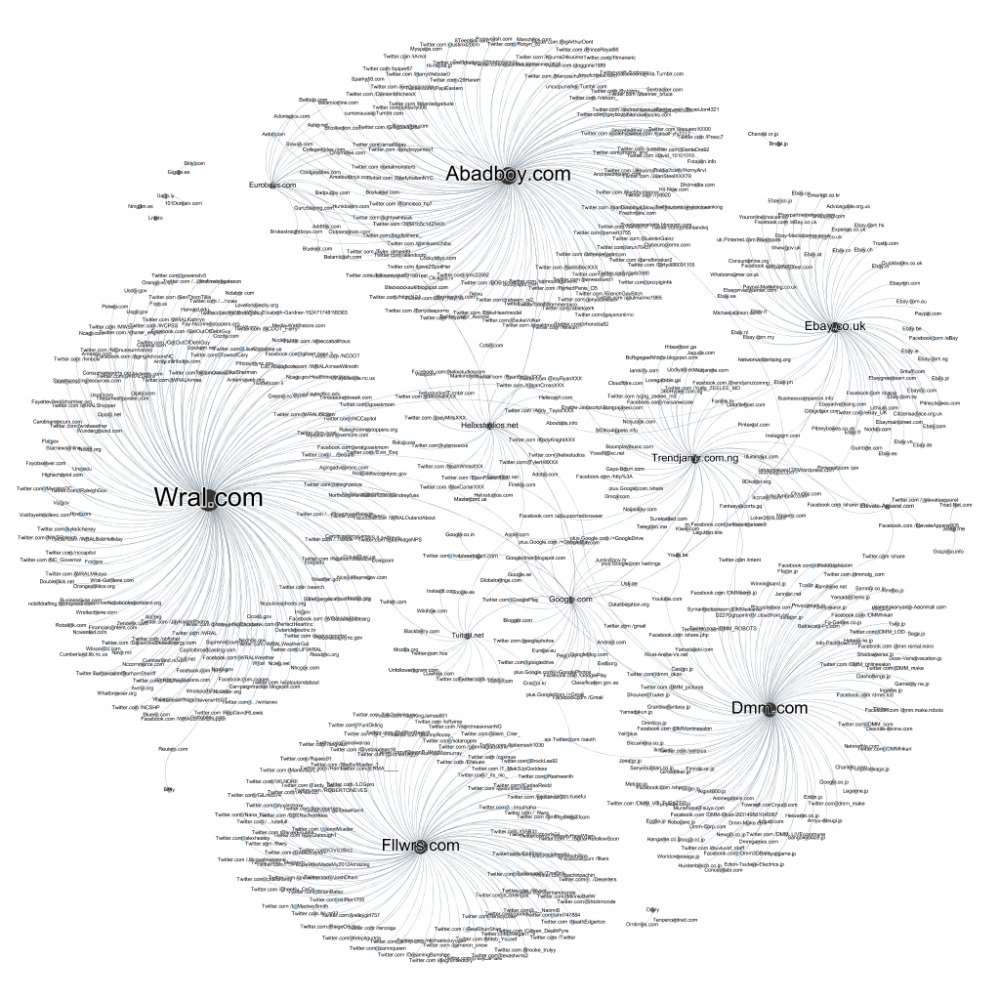

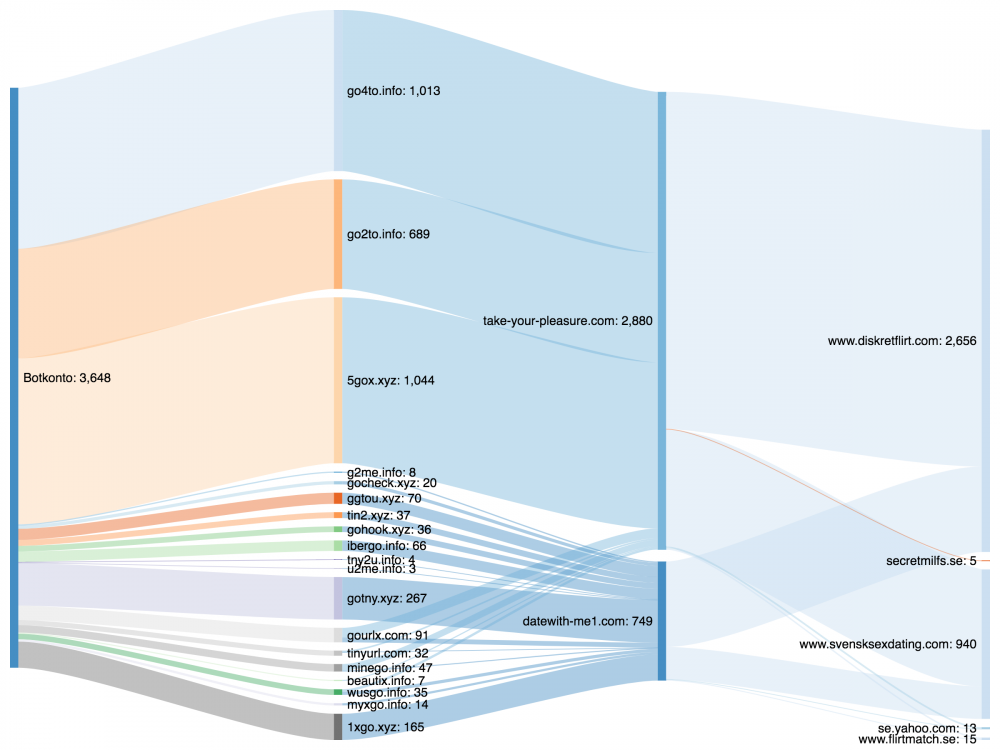

O Botjakten foi lançado em meados de janeiro como um projeto de crowdsourcing que consistia em um simples formulário do Google, onde usuários do Twitter podiam denunciar possíveis bots que seguiam ou compartilhavam seus tuítes. Além disso, os usuários passaram a compartilhar suas “listas negras”, o que permitiu a identificação de 5 mil bots. Embora alguns formulários tenham sido preenchidos com informações falsas, a lista era um ótimo ponto de partida para analisar o que aquelas contas tinham em comum – localização, foto de perfil, data de criação, número de retuítes, links externos, etc. Então o grupo criou um software para identificar um número ainda maior de bots, analisando a API de livestream do Twitter em busca de conteúdo sexual e hashtags associadas a bots. O programa gera uma visualização das atividades dos bots, mostrando, por exemplo, para quais sites os links dessas contas falsas apontam. O código de visualização foi escrito em JavaScript; já o software de detecção de bots, em Python.

Algumas semanas depois, os 30 mil bots identificados pelo software do Botjakten encerraram subitamente suas atividades; então, o grupo sueco resolveu examinar os seguidores desses perfis, na expectativa de descobrir mais bots. Foram encontradas mais 20 mil contas falsas. “Pensamos que talvez eles seguissem uns aos outros, e descobrimos que era isso mesmo que acontecia”, diz Andreas Segerberg, que, além de participar do projeto, também trabalha no Arquivo Municipal de Gotemburgo e como professor de Conservação Digital e Teoria Arquivística na Universidade de Gotemburgo. A API do Twitter limita o número de solicitações por minuto, o que fez com que o processo demorasse cerca de um mês.

O Botjakten está usando os dados coletados para, por exemplo, mapear a atividade dos bots pornôs e tentar descobrir de onde eles surgem – e qual é a verdadeira extensão do problema. A equipe também pretende analisar a proporção entre as contas suspensas e as que já foram desbloqueadas, recuperadas pelos seus donos depois de terem sido hackeadas.

Embora o Botjakten tenha interrompido a busca por contas falsas para se concentrar na parte de análise de dados do projeto, já existe uma segunda onda de bots na mira da equipe. Segundo Segerberg, o plano é continuar monitorando os bots e, por fim, publicar os resultados e denunciar todos os perfis falsos ao Twitter.

Depois disso, assim como Robert, o grupo pretende monitorar outro tipo de bot. “Em outubro teremos eleições na Suécia; teremos que ficar de olho nisso”, diz Segerberg.

A análise de dados ainda está em curso, mas o projeto já identificou algumas semelhanças entre os bots pornôs: o uso de imagens de um número reduzido de atrizes pornôs; uma sintaxe parecida na hora de postar links, que costumam apontar para dois sites pornográficos; e o uso de encurtadores de URL desconhecidos, com links para questionários que por sua vez redirecionam o usuário para um ou dois sites de paquera. Além de jogar o usuário de um site para outro, alguns sites associados aos bots mineram criptomoedas no navegador da vítima, usando o processador do computador invadido para ganhar dinheiro. Algumas contas parecem ter sido criadas como parte de uma rede de bots com o único intuito de mandar spam para outros usuários; outras parecem ter sido roubadas de pessoas de verdade – isso pode acontecer com quem usa senhas fracas ou os mesmos nomes de usuário e senha em sites diferentes, pois os hackers, depois de invadir uma conta, tentam usar esses dados para acessar outras contas do mesmo usuário.

Twitter está “mais proativo do que nunca”

As contas falsas viraram um problema sério para o Twitter nos últimos 18 meses, mas a caça independente aos bots já existe há mais tempo. O analista de segurança Rob Cook começou a rastrear bots pornôs em 2016 – e descobriu recentemente que cerca de 20% deles ainda estão na ativa. No mesmo ano, a empresa de cibersegurança Symantec descobriu que 2.500 contas do Twitter com um grande número de seguidores haviam sido invadidas por bots pornôs em apenas duas semanas. Fotos de perfil foram substituídas por imagens eróticas; nomes e bios, alteradas; e as contas passaram a tuitar links para sites de paquera suspeitos. Uma pesquisa publicada em março de 2017 estimava que de 9 a 15% dos perfis do Twitter poderiam ser falsos. Meses depois, o jornalista especializado em segurança da informação Joseph Cox seguiu o rastro de bots pornôs para escrever um artigo no Motherboard – portal de tecnologia da revista Vice – e descobriu “uma rede de mais de dez sites de paquera interligados e de aspecto suspeito”.

A onipresença dessas contas e a relativa facilidade com que usuários e pesquisadores podem descobri-las levanta a pergunta: por que o Twitter parece ter ficado para trás? Quando questionada sobre o assunto, uma porta-voz da empresa declarou: “Nossa equipe usa uma mistura de tecnologia e moderadores humanos para identificar e eliminar spams e tentativas de manipular nosso serviço. Esse trabalho é importante e vai continuar sendo uma prioridade para nós.” Ela também forneceu ao The Intercept informações sobre a política antispam do Twitter.

“Dada a escala do problema, e, como preferimos pecar pela vontade de proteger a voz dos usuários (…), o contexto é essencial na hora de analisarmos um determinado conteúdo.”

Quando perguntada por que as contas falsas continuam se proliferando e por que hackers podiam identificar bots ativos que o Twitter ainda não havia detectado, a porta-voz fez a seguinte declaração: “Centenas de milhões de tuítes são publicados diariamente, e nós usamos tanto as denúncias dos usuários quanto a nossa tecnologia para fazer com que as regras do Twitter sejam respeitadas. Dada a escala do problema, e, como preferimos pecar pela vontade de proteger a voz dos usuários – pois o que parece spam às vezes é uma atividade legítima –, o contexto é essencial na hora de analisarmos um determinado conteúdo. Empregamos diversas técnicas para combater o spam, dependendo do tipo de comportamento observado em uma determinada conta; essa abordagem nos ajuda a tomar decisões mais embasadas. Por exemplo, podemos ajudar um usuário a recuperar o controle de uma conta invadida, em vez de simplesmente deletá-la. Descobrimos novas formas de spam e manipulação de conteúdo todos os dias, e nossa equipe trabalha duro para garantir o cumprimento de nossas regras de maneira justa e confiável.” O Twitter afirma ser proativo no monitoramento do spam e da manipulação de conteúdo, excluindo contas que violem as regras do site, mas se recusa a comentar casos específicos por questões de privacidade e segurança.

No verão de 2017, o Twitter desmantelou a SIREN, uma gigantesca botnet (rede de bots) de mais de 90 mil bots pornográficos, com nomes e fotos de mulheres em poses provocantes e textos de teor sexual escritos em um inglês rudimentar. As contas foram excluídas depois que a ZeroFOX, uma empresa de cibersegurança de Baltimore, nos EUA, revelou os perfis e posts à equipe de segurança do Twitter. Porém, a botnet já havia gerado mais de 30 milhões de cliques no Twitter e em e-mails de spam.

Erin Gallagher, artista multimídia, escritora e tradutora, diz que o Twitter tem melhorado nos últimos anos. Ela sabe do que está falando, pois estuda as redes de bots do Twitter por meio de uma ferramenta chamada Gephi, que gera diagramas sobre a atividade desses bots, identificando agrupamentos (clusters) de retuítes, perfis que servem como concentradores (hubs) para outras contas, entre outras informações. “No último relatório, [o Twitter] afirma que, em dezembro de 2017, seus sistemas automatizados identificaram mais de 6,4 milhões de contas suspeitas por semana, o que é um número impressionante. Eles aumentaram sua capacidade de detecção em 60% de outubro para cá. Ao que parece, o Twitter está mais proativo do que nunca”, diz Gallagher. Além disso, explica ela, o Twitter seria mais criticado do que outras redes sociais porque usa uma API aberta, o que permite que pesquisadores independentes tenham acesso aos seus dados. Por fim, embora tenham conseguido contornar os mecanismos de monitoramento do Twitter, os hackers por trás dos bots pornôs podem ter mais dificuldade para se livrar de outros sistemas menores e menos conhecidos.

Mas Segerberg, do projeto Botjakten, afirma que é muito mais fácil criar do que denunciar um bot no Twitter. “Não há nenhum ‘captcha’ [teste de segurança usado para diferenciar humanos de bots] nem nada parecido na hora de se criar uma conta, mas, para denunciar um perfil falso, você tem que passar por umas cinco etapas”, reclama. Para denunciar uma conta, o usuário deve acessar o perfil em questão, clicar no ícone de menu, clicar “Denunciar”, selecionar a opção “Está publicando spam” e seguir as instruções da página para os passos seguintes. Denunciar um tuíte também é complicado: é preciso clicar no ícone de menu ao lado do tuíte em questão, selecionar “Denunciar Tweet”, selecionar a opção “É spam” e depois seguir as recomendações da página.

Tornar o procedimento de denúncia mais intuitivo para o usuário e aproveitar os dados de projetos independentes como o @PornBotHunter e o Botjakten poderia ajudar o Twitter a melhorar seu sistema antispam e suspender as contas que ainda estão em operação.

Tradução: Bernardo Tonasse

Temos uma oportunidade, e ela pode ser a última:

Colocar Bolsonaro e seus comparsas das Forças Armadas atrás das grades.

Ninguém foi punido pela ditadura militar, e isso abriu caminho para uma nova tentativa de golpe em 2023. Agora que os responsáveis por essa trama são réus no STF — pela primeira e única vez — temos a chance de quebrar esse ciclo de impunidade!

Estamos fazendo nossa parte para mudar a história, investigando e expondo essa organização criminosa — e seu apoio é essencial durante o julgamento!

Precisamos de 800 novos doadores mensais até o final de abril para seguir produzindo reportagens decisivas para impedir o domínio da máquina bilionária da extrema direita. É a sua chance de mudar a história!

Torne-se um doador do Intercept Brasil e garanta que Bolsonaro e sua gangue golpista não tenham outra chance de atacar nossos direitos.