Depois da revelação de que dados dos usuários do Facebook foram coletados ilegalmente para ajudar a eleger Donald Trump, o Facebook passou semanas pedindo desculpas, fazendo pequenas mudanças em sua política de dados e prometendo ser “mais transparente” – revelando mais informações sobre anúncios, por exemplo. Mas seus dois bilhões de usuários ainda sabem muito pouco sobre como anúncios são segmentados e direcionados para seus perfis – o que é basicamente o modelo de negócios da empresa. Agora, uma nova pesquisa revela uma provável explicação para isso: dizer a verdade causaria revolta.

O estudo, baseado em pesquisas realizadas na Harvard Business School e publicadas no Journal of Consumer Research, investiga a relação inconciliável entre a transparência e a persuasão publicitária. Mais especificamente, os pesquisadores analisaram o que acontece quando uma empresa revela às pessoas como elas foram escolhidas como público-alvo de um determinado anúncio. Por exemplo, quando um anunciante revela o algoritmo responsável por determinar, com base em uma miríade de dados comportamentais captados na internet, que você estaria interessado em uma promoção de meias. Praticamente qualquer pessoa que usa a internet está sujeita a esse direcionamento de anúncios, que aparecem quase sempre fora de contexto e sem nenhuma explicação.

Os participantes da pesquisa tinham que navegar em um site que exibia várias versões de uma mesma propaganda, diferenciadas apenas por um texto explicando por que o anúncio estava sendo exibido. Invariavelmente, os anúncios que diziam basear-se em dados coletados sobre a atividade dos usuários em outros sites causavam um distanciamento e desinteresse maior do que aqueles que não revelavam seus métodos de segmentação ou diziam basear-se na atividade do usuário em seu próprio site. Em outras palavras, se você rastrear o que as pessoas fazem na internet – caso do Facebook – e admitir isso para elas, isso pode acabar prejudicando a eficácia de seus anúncios. Segundo os pequisadores, os 449 participantes remunerados do estudo, recrutados na internet, tinham 24% menos chance de se interessar por um produto ou site depois de saber que sua atividade em outras páginas havia sido rastreada.

Em outra atividade relatada no mesmo estudo, alguns participantes eram foram informados de que os anúncios que estavam vendo haviam sido direcionados a eles graças a “informações que deduzimos sobre você”. Eles tinham 17% menos chance de se interessar por um produto do que aqueles que não foram informados de nada – ou dos que foram escolhidos com base em “informações oferecidas voluntariamente”. O Facebook deduz informações sobre seus usuários não só por meio de dados provenientes de outros sites, mas também do uso da inteligência artificial.

O paradoxo é evidente para uma empresa que passou recentemente a valorizar a transparência e a honestidade, mas que deve muito de seu valor de mercado à opacidade de suas práticas.

Involuntariamente, o estudo fornece uma resposta para uma questão crucial dos tempos atuais: por que o Facebook não abre logo o jogo? Por que tantas promessas vagas e tantas evasivas no Congresso americano? A conclusão da pesquisa é que não gostamos do que vemos quando as engrenagens da mineração de dados nos é revelada. Parece haver um tabu, algo de antinatural nos processos de segmentação de público-alvo que se tornaram rotineiros no mundo publicitário, uma violação de normas que consideramos invioláveis – mas que é muito mais difícil de ser percebida na internet do que na vida real. Porém, o que essa pesquisa indica é que a repulsa que sentimos ao saber que fomos categorizados por um algoritmo é muito parecida com a que experimentamos quando alguém trai a nossa confiança no mundo analógico.

Nas palavras de seus autores, o estudo “se baseou na ideia de que a transparência na publicidade reduz a eficácia dos anúncios ao evidenciar práticas de marketing que violam as crenças do consumidor com relação aos ‘fluxos de informação’ (a maneira pela qual informações pessoais são transmitidas entre as partes)”. Por exemplo, se uma loja de roupas pede o seu e-mail e começa a lhe mandar spam, você pode não gostar, mas provavelmente não vai considerar isso uma quebra de confiança. Porém, se essa mesma empresa rastrear seu telefone para obter informações sobre seus movimentos dentro da loja, você ficaria no mínimo incomodado. Como as operações publicitárias do Facebook dependem em grande medida de dados obtidos de forma invisível – ou protegida pelo manto do segredo comercial –, elas estão mais próxima do segundo do que do primeiro exemplo.

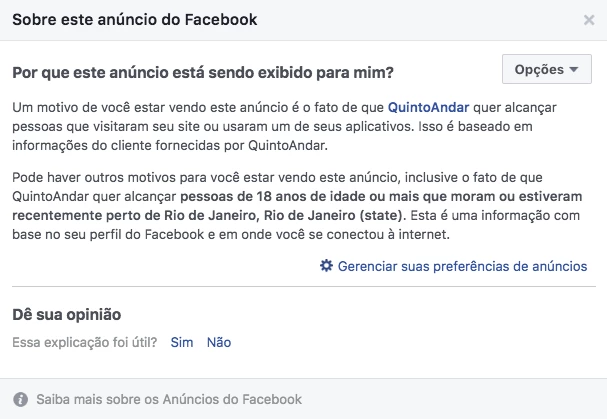

O Facebook afirma ser transparente em suas práticas publicitárias, mas essa transparência se resume a um texto extremamente vago – e escondido atrás de um botão minúsculo – que explica como o usuário foi escolhido para visualizar determinado anúncio:

O estudo afirma: “A clareza é uma coisa incomum no mercado atual. Os anúncios digitais não costumam vir acompanhados de informações sobre como foram gerados, e, quando vêm, isso é feito de forma discreta, acessível apenas para os consumidores mais insistentes.” Como na imagem acima.

“Anúncios transparentes que revelavam fluxos de informação inaceitáveis reduziram a eficácia da publicidade”

Os pesquisadores testaram o que aconteceria se os anúncios direcionados fossem automaticamente acompanhados de explicações sobre o processo de direcionamento, sem depender da curiosidade do usuário para buscar tal informação. E os resultados foram categóricos e reveladores: “Os anúncios transparentes eram menos eficazes quando admitiam ter rastreado dados em sites de terceiros – um fluxo de informação identificado por nosso estudo indutivo como inaceitável pelos consumidores (…). Anúncios transparentes que revelavam fluxos de informação inaceitáveis aumentaram a preocupação com a privacidade e reduziram o interesse pela personalização, reduzindo a eficácia da publicidade.”

Em outras palavras, pelo mesmo motivo que você pode não querer ver a cozinha suja onde prepararam aquele hambúrguer gorduroso, a transparência na publicidade pode ser profundamente alarmante.

Para quem acompanhou a série de pedidos de desculpas de Mark Zuckerberg este ano, isso parece contradizer uma das frases favoritas do CEO do Facebook: as pessoas querem anúncios direcionados. Essa ideia também apareceu no primeiro depoimento de Zuckerberg no Congresso dos EUA:

“Senador, as pessoas já têm controle sobre como suas informações são usadas em anúncios. Se você não quer que todas as informações à nossa disposição sejam usadas para direcionar anúncios, é possível desativar as informações de terceiros. Descobrimos que, embora algumas pessoas não gostem de anúncios, as pessoas não gostam mesmo é de anúncios irrelevantes [grifo do autor]. De fato, existe um certo desconforto com relação ao uso de informações para tornar os anúncios mais relevantes, mas, segundo o retorno que recebemos da comunidade, a esmagadora maioria dos usuários prefere que lhes mostremos anúncios relevantes.”

De acordo com Leslie John, professora associada da Harvard Business School e uma das autoras do artigo, essa defesa de Zuckerberg “é simplista demais”. Como os usuários não podem decidir não ver nenhum anúncio, é natural que escolham ao menos os anúncios mais “relevantes”. Porém, como escreve John em um artigo para a Harvard Business Review que acompanhou a pesquisa, “as pesquisas que embasam a personalização de anúncios tendem a estudar consumidores que não têm muita consciência de que suas informações pessoais determinam quais anúncios são exibidos”.

Ou, como John explica por e-mail: “Se eu tiver que ver anúncios, então vou preferir aqueles que são relevantes para mim, mas com uma ressalva: desde que eu sinta que meus dados pessoais estão sendo usados corretamente. A partir do momento em que as pessoas sentem que a privacidade delas está sendo violada, é compreensível que elas fiquem incomodadas e desconfiadas.” Pelo visto, a alegação de Zuckerberg de que as pessoas querem que suas informações pessoais e atividade na internet sejam rastreadas e analisadas em escala industrial só se aplica quando isso acontece sem o conhecimento delas.

Se as conclusões da pesquisa estiverem corretas, não é de se admirar que o Facebook não queira revelar a matemática por trás dos panos: as pessoas ficariam menos inclinadas a consumir. “As empresas se sentem desestimuladas a revelar fluxos de informação desagradáveis, e isso pode ser uma explicação para querer escondê-los”, concorda John.

Tradução: Bernardo Tonasse

Temos uma oportunidade, e ela pode ser a última:

Colocar Bolsonaro e seus comparsas das Forças Armadas atrás das grades.

Ninguém foi punido pela ditadura militar, e isso abriu caminho para uma nova tentativa de golpe em 2023. Agora que os responsáveis por essa trama são réus no STF — pela primeira e única vez — temos a chance de quebrar esse ciclo de impunidade!

Estamos fazendo nossa parte para mudar a história, investigando e expondo essa organização criminosa — e seu apoio é essencial durante o julgamento!

Precisamos de 800 novos doadores mensais até o final de abril para seguir produzindo reportagens decisivas para impedir o domínio da máquina bilionária da extrema direita. É a sua chance de mudar a história!

Torne-se um doador do Intercept Brasil e garanta que Bolsonaro e sua gangue golpista não tenham outra chance de atacar nossos direitos.