Uma versão desse texto foi publicada inicialmente nossa newsletter. Assine. É de graça. Todos os sábados na sua caixa de e-mails.

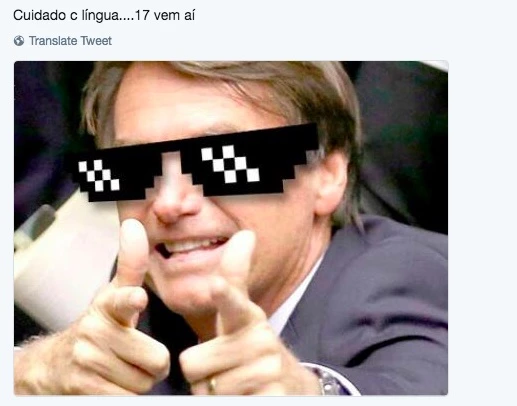

Eu postei no Twitter a reportagem da revista Veja. Uma das primeiras reações – fora comentários de seguidores e retweets previsíveis – foi essa aqui:

É algo previsível vindo dos apoiadores de Jair Bolsonaro quando confrontados com a realidade: ironia e ameaças – veladas ou explícitas. Só na semana passada, uma jornalista foi perseguida e exposta no Twitter por engano, a autora da reportagem que mostrou que o mesmo candidato havia ameaçado a ex-mulher em 2011 também foi exposta, e Carlos Bolsonaro, vereador e filho de Jair Bolsonaro, postou uma foto com uma simulação de tortura, feita originalmente em protesto contra seu pai, com uma legenda irônica para meio milhão de seguidores no Instagram. Todos esses conteúdos – exceto o stories de Bolsonaro, efêmero por natureza – ainda estão no ar. A resposta ao meu tuíte também, mesmo depois de ser denunciada.

As grandes plataformas de internet – Twitter, Facebook, Google – estão concentrando o debate público na campanha e são categóricas em afirmar que proíbem violações claras de direitos humanos, como racismo, homofobia, incitação à violência e ameaças. Seus termos de uso também são claros ao proibir esse tipo de postagem. Na prática, porém, elas costumam dar mais valor a outro direito – a liberdade de expressão – e jogam para as vítimas a responsabilidade de denunciar os abusos e provar que estão sendo perseguidas, ameaçadas ou expostas. Normalmente, o lado mais frágil perde. O padrão da radicalização se perpetua.

Radicalização é a alma do negócio

É claro que as grandes empresas de internet, palco do grande debate político hoje, não têm interesse em violações de direitos humanos em suas plataformas. Não é mentira quando elas dizem que trabalham para manter o ambiente online limpo e saudável. Problemas com a justiça custam caro e, se um juiz mandar, elas são obrigadas a remover conteúdos (mesmo aqueles que não sejam tão ofensivos assim).

Elas não precisam esperar pela canetada de um juiz e também podem remover posts por conta própria caso avaliem que eles ferem suas políticas. Mas, como não são obrigadas a fazer isso, acabam priorizando a liberdade de expressão – até porque, na balança dos negócios, é melhor deixar a polêmica no ar.

Na verdade, a questão é mais profunda: a radicalização nos discursos é parte inseparável de seu negócio. A roda das redes sociais é movida por ódio.

Vídeos sobre começar a correr levavam a vídeos sobre ultramaratonas. Vídeos sobre vegetarianismo levavam ao veganismo.

Os algoritmos sabem que tipo de conteúdo nos mantém ligados nas plataformas e passam a priorizá-lo. Posts que despertam reações emocionais, que dão vontade de compartilhar, dar like, retuitar, vídeos que dão vontade de comentar: esse é o tipo de conteúdo que prende a nossa atenção e pode ser revertido em lucros com publicidade. Quanto mais tempo passamos nas redes, quanto mais clicamos, mas somos expostos a anúncios publicitários. E não é por acaso que, nessa lógica em que o conteúdo com apelo emocional é, normalmente, o que dá certo e retém atenção, o algoritmo passe a levar nossas preferências ao extremo. Até a radicalização.

O Facebook, que privilegia conteúdos compartilhados por amigos, se tornou um ambiente fértil para a disseminação de notícias falsas. Geralmente apelando para o emocional com chamadas duvidosas, elas têm 70% mais chance de se espalharem, segundo um estudo do MIT. Um estudo do Pew, um instituto de pesquisas, mostrou que posts polêmicos e que geram indignação recebem em média três vezes mais comentários e são duas vezes mais compartilhados no Facebook. Nada disso é aleatório. É o coração de seus modelos de negócio, que geram lucro em cima da nossa atenção. Eles funcionam.

Produtos, ideias, experiências e ideologias

A pesquisadora Zeynep Tufekci, professora na Universidade da Carolina do Norte, nos EUA, dá o exemplo no YouTube: se você se interessar por um assunto, é provável que o algoritmo comece a te indicar vídeos relacionados até chegar a extremos. Vídeos sobre começar a correr levavam a vídeos sobre ultramaratonas; vídeos sobre vegetarianismo levavam ao veganismo. E o mesmo acontecia com a política: vídeos sobre Trump levavam a vídeos da ultradireita. É o próprio algoritmo que indica o conteúdo e leva o usuário para o lado mais extremo, sem que ele se dê conta.

Tufecki, em um artigo na revista Wired, ironiza o lema do Facebook: dar às pessoas poder para construir comunidades e aproximar o mundo. Ok, o Facebook reúne amigos da escola. Mas também permite que supremacistas se encontrem e se fortaleçam em grupo. A defesa da liberdade de expressão a unhas e dentes da rede social também permite que opiniões antidemocráticas floresçam e ganhem escala. Estamos no que ela chama de era de ouro da liberdade de expressão – ao mesmo tempo, uma era intermediada por poucas empresas que concentram a nossa comunicação e decidem o que vemos ou não com base em seus próprios critérios (ou seja: o que for mais lucrativo para publicidade).

Para descobrirem nossos gostos e vontades – e, assim, exibirem conteúdo que possivelmente prenderá nossa atenção –, o ecossistema de publicidade online investe pesadamente em engenharia e análise de dados (que passa, inclusive, pela psicologia). “É preciso medir as parcialidades da subjetividade do sujeito para entender como atacá-lo com anúncios”, diz Lori Regattieri, doutoranda em comunicação e pesquisadora do MediaLab.UFRJ, laboratório de pesquisa da Escola de Comunicação da Universidade Federal do Rio de Janeiro. “E aqui não estamos falando só de produtos, estamos falando de ideias, experiências, e inclusive, ideologias.”

Viciados em radicalismo

Ao usar a internet para manipular sentimentos primitivos, como o medo, o ódio e a sexualidade, conservadores conseguem combinar táticas de manipulação de massas descritas por Freud e Theodor Adorno há 70 anos com um sistema que vicia as pessoas em radicalismo. A comunicação de apoio a Jair Bolsonaro nas redes sociais reflete isso.

Ela é basicamente relacionada a questões morais – punição a criminosos, porte de armas, mulheres e sexualização da infância. Ela estimula os sentimentos primitivos e a radicalização – encontra um terreno fértil para viralizar em um sistema que privilegia esse tipo de conteúdo.

Ninguém sabe direito ainda qual é o impacto dessa sociedade que se cria com mecanismos sofisticados de vigilância e poder concentrado. Dar voz às pessoas comuns sempre foi um apelo das redes sociais, que apareceram como uma poderosa ferramenta de democratização das comunicações. Na prática, não foi bem isso o que aconteceu. Os mecanismos de manipulação, que passam despercebidos da maior parte dos usuários, são tão eficientes em vender ideias quanto produtos. E, se combinados a um governo autoritário – o que já está acontecendo na China, por exemplo – seus efeitos podem ser desastrosos para a democracia.

As plataformas de internet se equilibram no frágil argumento de que são neutras. É claro que não são. Algoritmos são alimentados pelo comportamento humano, e o humanos não são neutros, especialmente em um período de acirramento dos ânimos. Se querem realmente criar comunidades e ambientes seguros para seus usuários, essas empresas precisam assumir claramente o papel que elas têm: de intermediar a conversa. E isso inclui ser transparente em relação aos critérios dos algoritmos ao privilegiar informações, a maneira como elas são utilizadas em campanhas políticas e, principalmente, atuar ativamente para impedir que violações sejam mantidas, especialmente porque seu próprio sistema carrega os usuários pelas mãos até os extremos.

DOE FAÇA PARTE

Intercept Brasil existe para produzir jornalismo sem rabo preso que você não encontra em nenhum outro lugar.

Enfrentamos as pessoas e empresas mais poderosas do Brasil porque não aceitamos nenhum centavo delas.

Dependemos de nossos leitores para financiar nossas investigações. E, com o seu apoio, expusemos conspirações, fraudes, assassinatos e mentiras.

Neste ano eleitoral, precisamos colocar o maior número possível de repórteres nas ruas para revelar tudo o que os poderosos querem esconder de você.

Mas não podemos fazer isso sozinhos. Precisamos de 300 novos apoiadores mensais até o final do mês para financiar nossos planos editoriais. Podemos contar com seu apoio hoje?